J’ai récemment été frustré en travaillant avec Claude, et cela m’a conduit à un échange intéressant avec la plateforme, qui m’a amené à examiner mes propres attentes, actions et comportements… et cela m’a ouvert les yeux. La version courte est que je veux continuer à considérer l’IA comme un assistant, comme un partenaire de laboratoire. En réalité, il faut le voir comme un robot de laboratoire – capable de réaliser des choses impressionnantes, si on lui donne la bonne direction, mais seulement dans un cadre solide. Il y a encore tellement de choses dont elle n’est pas capable, et nous, en tant que praticiens, l’oublions parfois et faisons des hypothèses basées sur ce que nous souhaitons qu’une plateforme soit capable de faire, au lieu de l’ancrer dans la réalité des limites.

Et même si les limites de l’IA sont aujourd’hui vraiment impressionnantes, elles ne sont rien en comparaison de ce dont les gens sont capables. Est-ce qu’on néglige parfois cette différence et attribue-t-on des caractéristiques humaines aux systèmes d’IA ? Je parie que nous l’avons tous fait à un moment ou à un autre. Nous avons assumé la précision et pris la direction. Nous avons pris pour acquis « c’est évident » et nous nous attendions à ce que la réponse « inclue l’évidence ». Et nous sommes contrariés quand cela nous fait défaut.

L’IA semble parfois humaine dans sa façon de communiquer, mais elle ne se comporte pas comme un humain dans sa manière de fonctionner. C’est dans cet écart entre l’apparence et la réalité que commencent réellement la confusion, la frustration et l’utilisation abusive des grands modèles de langage. La recherche sur l’interaction homme-machine montre que les gens anthropomorphisent naturellement les systèmes qui parlent, répondent socialement ou reflètent les modèles de communication humains.

Il ne s’agit pas d’un manque d’intelligence, de curiosité ou d’intention de la part des utilisateurs. C’est un échec des modèles mentaux. Les gens, y compris les professionnels hautement qualifiés, abordent souvent les systèmes d’IA avec des attentes façonnées par la façon dont ces systèmes se présentent plutôt que par leur fonctionnement réel. Le résultat est un flux constant de déceptions attribuées à tort à une technologie immature, à des invites faibles ou à des modèles peu fiables.

Le problème n’est rien de tout cela. Le problème, c’est l’attente.

Pour comprendre pourquoi, nous devons examiner séparément deux groupes différents. Consommateurs d’un côté, praticiens de l’autre. Ils interagissent différemment avec l’IA. Ils échouent différemment. Mais les deux groupes réagissent au même décalage sous-jacent entre ce que ressent l’IA et son comportement réel.

Du côté du consommateur, où la perception domine

La plupart des consommateurs rencontrent l’IA via des interfaces conversationnelles. Les chatbots, les assistants et les moteurs de réponse parlent avec des phrases complètes, utilisent un langage poli, reconnaissent les nuances et répondent avec une empathie apparente. Ce n’est pas accidentel. La maîtrise du langage naturel est la principale force des LLM modernes, et c’est la fonctionnalité que les utilisateurs expérimentent en premier.

Quand quelque chose communique comme le fait une personne, les humains lui attribuent naturellement des traits humains. Compréhension. Intention. Mémoire. Jugement. Cette tendance est bien documentée dans des décennies de recherche sur l’interaction homme-machine et l’anthropomorphisme. Ce n’est pas un défaut. C’est ainsi que les gens donnent un sens au monde.

Du point de vue du consommateur, ce raccourci mental semble généralement raisonnable. Ils n’essaient pas de faire fonctionner un système. Ils essaient d’obtenir de l’aide, des informations ou du réconfort. Lorsque le système fonctionne bien, la confiance augmente. En cas d’échec, la réaction est émotionnelle. Confusion. Frustration. Le sentiment d’avoir été induit en erreur.

Cette dynamique est importante, d’autant plus que l’IA est désormais intégrée aux produits du quotidien. Mais ce n’est pas là que se produisent les échecs les plus conséquents.

Ceux-ci apparaissent du côté des praticiens.

Définir clairement le comportement du praticien

Un praticien n’est pas défini par le titre de son poste ou par sa profondeur technique. Un praticien se définit par la responsabilité.

Si vous utilisez occasionnellement l’IA par curiosité ou par commodité, vous êtes un consommateur. Si vous utilisez l’IA à plusieurs reprises dans le cadre de votre travail, intégrez ses résultats dans les flux de travail et êtes responsable des résultats en aval, vous êtes un praticien.

Cela inclut les responsables SEO, les responsables marketing, les stratèges de contenu, les analystes, les chefs de produit et les dirigeants qui prennent des décisions basées sur un travail assisté par l’IA. Les pratiquants n’expérimentent pas. Ils sont en train de s’opérationnaliser.

Et c’est là que le problème du modèle mental devient structurel.

Les praticiens ne traitent généralement pas l’IA comme une personne, au sens émotionnel du terme. Ils ne croient pas qu’il ait des sentiments ou une conscience. Au lieu de cela, ils le traitent comme un collègue dans le sens du flux de travail. Souvent comme un jeune collègue compétent.

Cette distinction est subtile, mais cruciale.

Les praticiens ont tendance à supposer qu’un système suffisamment avancé déduira l’intention, maintiendra la continuité et exercera son jugement, sauf indication contraire explicite. Cette hypothèse n’est pas irrationnelle. Cela reflète le fonctionnement des équipes humaines. Les professionnels expérimentés s’appuient régulièrement sur un contexte partagé, des priorités implicites et une intuition professionnelle.

Mais les LLM ne fonctionnent pas de cette façon.

Ce qui ressemble à de l’anthropomorphisme dans le comportement du consommateur se révèle comme une délégation mal placée dans les flux de travail des praticiens. La responsabilité dérive tranquillement de l’humain vers le système, non pas émotionnellement, mais opérationnellement.

Vous pouvez observer cette dérive selon des modèles très spécifiques et reproductibles.

Les praticiens délèguent fréquemment des tâches sans préciser pleinement les objectifs, les contraintes ou les critères de réussite, en supposant que le système déduira ce qui compte. Ils se comportent comme si le modèle maintenait une mémoire stable et une conscience continue des priorités, même s’ils savent intellectuellement que ce n’est pas le cas. Ils s’attendent à ce que le système prenne des initiatives, signale les problèmes ou résolve les ambiguïtés de lui-même. Ils surpondèrent la maîtrise et la confiance dans les résultats tout en sous-pondérant la vérification. Et au fil du temps, ils commencent à décrire les résultats comme des décisions prises par le système plutôt que comme des choix qu’ils ont approuvés.

Rien de tout cela n’est négligent. Il s’agit d’un transfert naturel des habitudes de travail de la collaboration humaine vers l’interaction système.

Le problème est que le système ne possède pas de jugement.

Pourquoi ce n’est pas un problème d’outillage

Lorsque l’IA est sous-performante dans un contexte professionnel, l’instinct est de rejeter la faute sur le modèle, les invites ou la maturité de la technologie. Cet instinct est compréhensible, mais il passe à côté du problème principal.

Les LLM se comportent exactement comme ils ont été conçus pour se comporter. Ils génèrent des réponses basées sur des modèles de données, dans le cadre de contraintes, sans objectifs, valeurs ou intentions propres.

Ils ne savent pas ce qui compte à moins que vous leur disiez. Ils ne décident pas à quoi ressemble le succès. Ils n’évaluent pas les compromis. Ils ne sont pas propriétaires des résultats.

Lorsque les praticiens assignent des tâches de réflexion qui appartiennent encore aux humains, l’échec n’est pas une surprise. C’est inévitable.

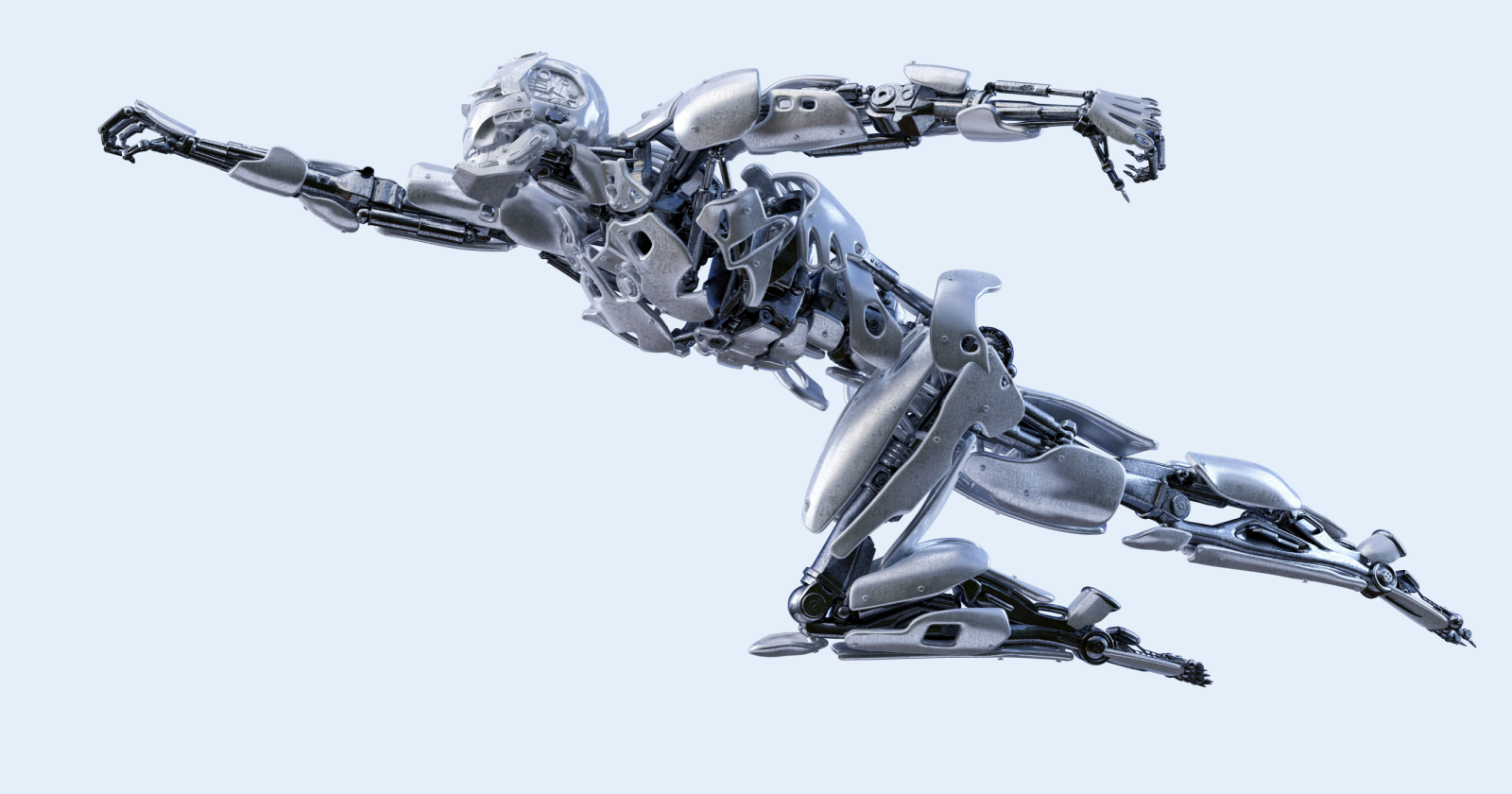

C’est là que penser à Ironman et Superman devient utile. Pas comme un anecdote sur la culture pop, mais comme une correction du modèle mental.

Ironman, Superman et autonomie mal placée

Superman fonctionne de manière indépendante. Il perçoit la situation, décide de ce qui compte et agit selon son propre jugement. Il se tient à vos côtés et sauve la situation.

C’est ainsi que de nombreux praticiens s’attendent implicitement à ce que les LLM se comportent au sein des flux de travail.

Ironman fonctionne différemment. La combinaison amplifie la force, la vitesse, la perception et l’endurance, mais elle ne fait rien sans pilote. Il s’exécute sous contraintes. Il fait apparaître des options. Cela étend les capacités. Il ne choisit ni objectifs ni valeurs.

Les LLM sont Homme de fer costumes.

Ils amplifient l’intention, la structure et le jugement que vous leur apportez. Ils ne remplacent pas le pilote.

Une fois que vous voyez clairement cette distinction, beaucoup de frustration s’évapore. Le système cesse de paraître peu fiable et commence à se comporter de manière prévisible, car les attentes ont évolué pour correspondre à la réalité.

Pourquoi c’est important pour les leaders du référencement et du marketing

Les responsables du référencement et du marketing opèrent déjà au sein de systèmes complexes. Les algorithmes, plateformes, cadres de mesure et contraintes que vous ne contrôlez pas font partie du travail quotidien. Les LLM ajoutent une autre couche à cette pile. Ils ne le remplacent pas.

Pour les responsables SEO, cela signifie que l’IA peut accélérer la recherche, élargir le contenu, faire apparaître des modèles et faciliter l’analyse, mais elle ne peut pas décider à quoi ressemble l’autorité, comment les compromis doivent être faits ou ce que le succès signifie pour l’entreprise. Cela reste des responsabilités humaines.

Pour les responsables marketing, cela signifie que l’adoption de l’IA n’est pas principalement une décision en matière d’outillage. Il s’agit d’une décision de placement des responsabilités. Les équipes qui traitent les LLM comme des décideurs introduisent des risques. Les équipes qui les traitent comme des couches d’amplification évoluent de manière plus sûre et plus efficace.

La différence n’est pas la sophistication. C’est la propriété.

La vraie correction

La plupart des conseils sur l’utilisation de l’IA se concentrent sur de meilleures invites. L’incitation est importante, mais elle se situe en aval. La véritable correction consiste à se réapproprier la pensée.

Les humains doivent s’approprier les objectifs, les contraintes, les priorités, l’évaluation et le jugement. Les systèmes peuvent gérer l’expansion, la synthèse, la vitesse, la détection de modèles et la rédaction.

Lorsque cette limite est claire, les LLM deviennent remarquablement efficaces. Quand cela se brouille, la frustration s’ensuit.

L’avantage silencieux

Voici la partie qui est rarement dite à voix haute.

Les praticiens qui internalisent ce modèle mental obtiennent systématiquement de meilleurs résultats avec les mêmes outils que tous les autres. Non pas parce qu’ils sont plus intelligents ou plus techniques, mais parce qu’ils cessent de demander au système d’être quelque chose qu’il n’est pas.

Ils pilotent la combinaison, et c’est leur avantage.

L’IA ne prend pas le contrôle de votre travail. Vous n’êtes pas remplacé. Ce qui change, c’est là où réside la responsabilité.

Traitez l’IA comme une personne et vous serez déçu. Traitez-le comme un système et vous serez limité. Traitez-le comme un costume Ironman, et TOI sera amplifié.

L’avenir n’appartient pas à Superman. Il appartient aux personnes qui savent piloter la combinaison.

Plus de ressources :

Cet article a été initialement publié sur Duane Forrester Decodes.